谷歌发布TimesFM-2.5模型,长上下文预测能力大幅提升

谷歌发布TimesFM-2.5模型,长上下文预测能力大幅提升

提起时间序列预测,很多人可能会觉得那是“数据分析师”的专利,或者是某些科学家夜夜熬夜才能玩转的深奥东西。其实,不然。而且,随着大模型技术的飞速发展,时间序列预测的“门槛”也在悄悄下降。就拿谷歌最近发布的TimesFM-2.5来看,简直给了整个科技圈一个不小的“下马威”。

从粗犷到精致:小而能打的TimesFM-2.5

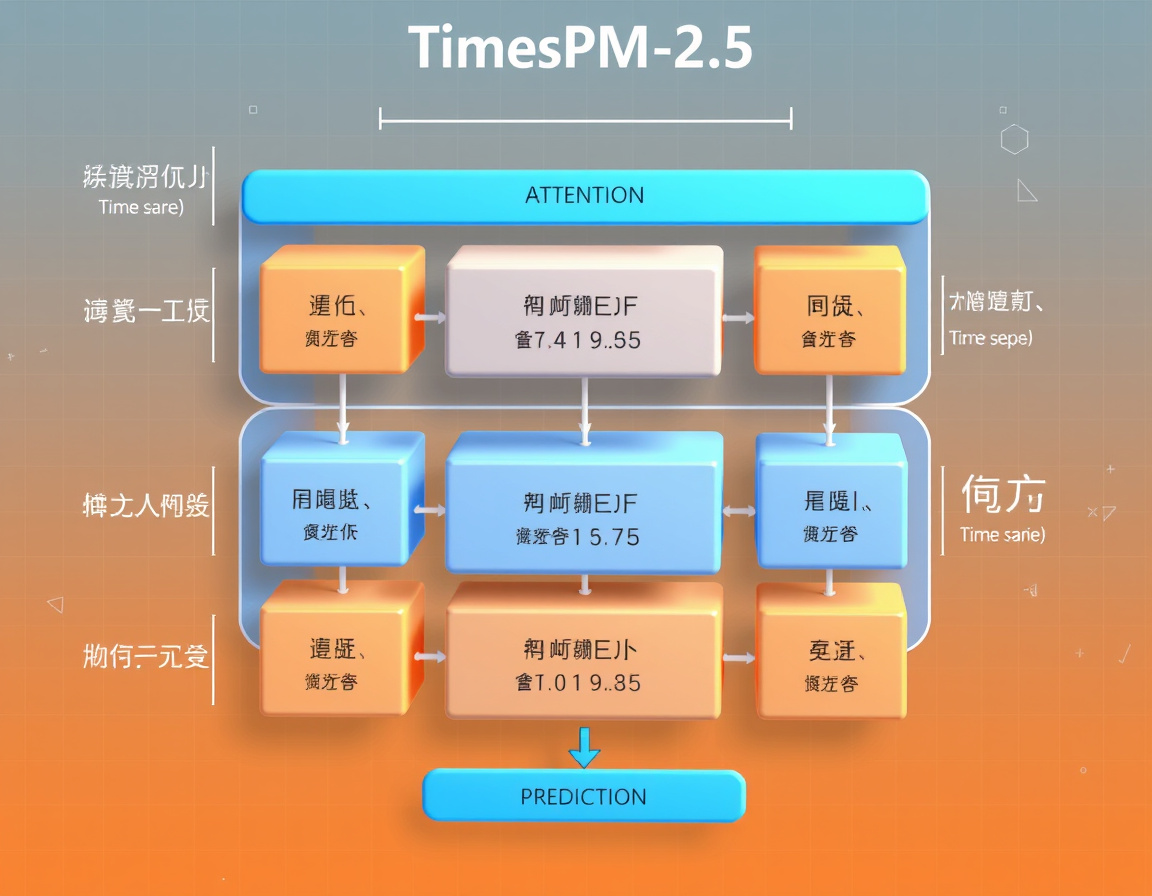

这次谷歌带来的TimesFM-2.5,有点像是你那台老旧笔记本电脑经过“瘦身”升级后,突然爆发了劲儿。它的参数量从前代的500M骤减到只有200M,这种缩减幅度让人都有点怀疑:会不会因此牺牲了性能?答案是——完全没让人失望。反而,那个看似隐形的“秘密武器”是它支持的上下文长度。16,384个数据点,比之前多出一大截,换句话说,它能捕捉到更长时间维度里的信息,洞察复杂动态的能力被大大增强。

这就好比在观察市场的涨跌、气候的变化或机器的运转时,TimesFM-2.5不仅仅盯着眼前发生什么,更能“看远”,帮你抓住长期趋势,做出更靠谱的预测。对于企业尤其重要,从库存管理到风险控制,长上下文理解就像提前知道天气预报一样,让决策不再盲目瞎猜。

本地概率预测:啥意思?

你可能会问,预测不就是告诉未来会发生什么吗?TimesFM-2.5给预测加了个“保险”,它不仅告诉你结果,还会告诉你预测的“靠谱程度”。这叫做“本地概率预测”。通俗点说,就是不管结果有多准确,它还会告诉你这次预测的信心指数。

在实际生活中,这玩意儿的价值无法用数字轻松衡量。想想供应链崩了,导致货物积压或断货,或者工业设备突然坏掉,不确定性带来的损失是巨大的。TimesFM-2.5能够给出风险的预警概率,帮企业提前做好准备,这样的功能更接地气,也更能打动有实际需求的业界大佬们。

大模型圈子里的“另类”

2025年,AI圈的“大模型”风头正劲,语言模型、图像生成、视频理解层出不穷,但TimesFM-2.5则坚定地做着时间序列预测这件“小而美”的事情。从表面上看,参数少,体积小,没啥“噱头”,但正是这种极简主义,让它走得更远也更灵活。

谈到这里,我忍不住想起一句俗话——“有时候,少即是多”。这不仅仅是文艺范儿说说,而是科技圈的真实写照。TimesFM-2.5告诉我们,超大规模不一定是唯一出路,结合上下文管理能力,把复杂计算拆解成高效模块,有时候反而能护盘得更稳。

为什么这对科技热点如此重要?

这次谷歌的成果不仅仅是一个模型升级那么简单,更在于它对时间序列未来发展的导向示范。时间序列数据随处可见,监测环境、金融市场、自动驾驶甚至气象预报,全靠这群看似“冷门”的预测模型撑起半边天。

尤其是随着边缘计算和实时监控需求日益增长,把这样一个小巧但全能的模型推到手边设备上的前景非常诱人。比如,智能制造的传感器,抑或无人机实时获取的环境数据,都能够用TimesFM-2.5做本地、快速的长时序预测,省成本也省时间。

此外,谷歌选择在Hugging Face平台开放TimesFM-2.5,完全拉开了时间序列预测的技术门槛。过去这种应用多是“高墙”技术,但现在,任何数据爱好者、从学生到独立开发者,都可以轻松试水。科技热点中,真正能从研究室跳跃到大众社会的项目,少之又少。这一步,意味着时间序列预测,正在被推向全社会。

说到底,这是个高级的玩意儿

如果你把TimesFM-2.5看作纯粹的数字游戏,怕是错过了它背后更深层的暗流。它代表了AI基础设施设计思路的变化——要有足够的广度覆盖更多的应用,也要有深度处理极长序列的要求。大模型不能再单打独斗,必须更加智慧地“分工合作”。

现实是,今天的人们生活节奏变快,数据更新快且密集,只有超级精准的预测才能真正支持复杂决策。TimesFM系列的升级,犹如给大模型插上了“长视野”的翅膀,让预测不再盲目,更多呈现出“全局观”。

只要代码一运行起来,它就像懂点儿“心思”的老朋友,早早在数据里帮你埋雷排雷,提前规划。

收尾聊聊心里话

2025年末,当一些大模型依旧在吹嘘巨量参数、标榜超级计算能力时,TimesFM-2.5的诞生仿佛敲了敲桌子,提醒你:大不一定等于全能。科技热点永远在变,但把握需求本质,才是王道。

而且,跟其他AI大模型相比,TimesFM-2.5这种专注时间序列的模型,更像是把握了某种“专一”的美学,对现实问题直戳脉搏。接下来的故事,无论是金融预测的波澜壮阔,还是工业控制的细水长流,都可能因这款“小而强”的大模型而发生微妙改变。

说到底,你有没有耐心躺下来,用心感受一串数据背后的时间故事?TimesFM-2.5已经准备好为你读懂未来,那你呢?

评论功能已关闭